苹果最近真是「高产」!

这几天,苹果在多模态 web 搜索中发现了赋能多模态大语言模型(MLLM)的新解法

在现实世界的应用中,MLLM 需要访问外部知识源,并对动态变化的现实世界信息进行实时响应,从而解决信息检索和知识密集型的用户查询。当前的一些方法,比如检索增强生成(RAG)、search agent 以及配备搜索功能的多模态大模型,往往存在流程僵化、搜索调用过多以及搜索查询构造不当等问题,导致效率低下以及结果不理想。

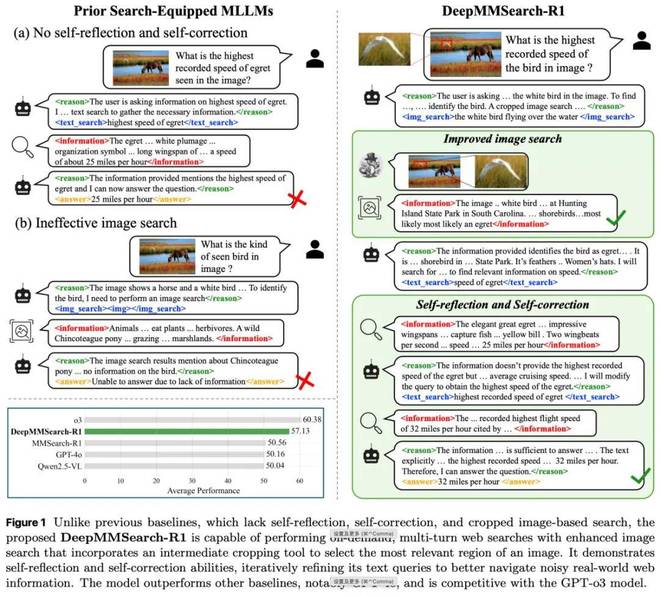

为了克服以往研究中暴露出的局限,苹果提出了 DeepMMSearch-R1 模型。该模型能够按需执行多轮网络搜索,并可针对文本与图像搜索工具动态生成查询,如图 1(右)所示。具体而言,DeepMMSearch-R1 能够通过自我反思与自我纠正,在多轮交互中自适应地生成和优化文本搜索查询,并利用检索到的内容作为反馈以及结合原始问题进行改进。

为了提升图像搜索的效果,苹果引入一个中间图像裁剪工具(Grounding DINO)来应对背景噪声和干扰性视觉实体带来的挑战。过程中,DeepMMSearch-R1 首先生成与问题最相关视觉实体的指代表达,然后利用该表达由裁剪工具动态识别并裁剪出图像中对应的区域。生成的裁剪图像随后被用于图像搜索,以检索与上下文更相关的结果。这种有针对性的搜索方式显著提升了检索质量,并大幅提高了整体性能。

苹果采用两阶段训练流程:首先进行有监督微调(SFT),然后通过 GRPO 算法进行在线强化学习(RL)。其目标是让模型学会何时发起搜索、使用哪种工具、搜索什么内容,以及如何基于检索到的内容进行推理,以决定下一步行动:是直接给出最终答案,还是进一步优化查询并发起新一轮搜索。

本文主要包括以下三个方面的贡献:

一是提出新的数据集 DeepMMSearchVQA。该数据集包含多样化多跳视觉问答样本,并以多轮对话的形式呈现。它在不同知识类别之间保持平衡分布,涵盖了既需要搜索又无需搜索的问题类型。

二是构建真实世界的多模态搜索流程,并整合了三种工具:(1)文本搜索工具,使模型能够发出有针对性的查询,从而检索相关网页并获取最新的事实性知识;(2)基于 Grounding DINO 的图像定位工具,可根据模型生成的与问题视觉实体相关的指代表达,识别并裁剪输入图像中的相关区域;(3)图像搜索工具,可基于输入图像(无论是裁剪图还是完整图)检索网页内容,包括标题与描述,帮助模型通过网络信息识别不熟悉的视觉实体。

三是通过两阶段训练过程实现了 SOTA 性能,超越以往的开源基线模型(见图 1)。该训练过程包括使用 SFT 进行冷启动初始化,随后采用 GRPO 算法进行在线强化学习。